TinyML ist einer der spannendsten Trends im Embedded-Engineering. Die Möglichkeit, Machine Learning auf Mikrocontrollern direkt auf dem Edge-Device auszuführen, eröffnet völlig neue Anwendungsfelder. Wer heute TensorFlow Lite ESP32 Projekte realisiert, profitiert von lokaler Intelligenz – von vorausschauender Wartung bis hin zu komplexer Sensorfusion.

Dieses TinyML Tutorial Deutsch führt Sie durch den gesamten Workflow: Vom effizienten Modell-Training Python bis zum Deployment der ESP32 Inferenz mittels TensorFlow Lite for Microcontrollers.

Was ist TensorFlow Lite?

TensorFlow Lite (TFLite) ist die auf Effizienz getrimmte Variante des Google-Frameworks TensorFlow. Für Embedded-Entwickler, die Machine Learning auf Mikrocontrollern betreiben wollen, ist besonders TensorFlow Lite for Microcontrollers relevant. Es ist speziell darauf ausgelegt, ML-Modelle auf Hardware mit begrenztem Speicher (wenige Kilobyte RAM) auszuführen. Das macht es zur perfekten Wahl für TensorFlow Lite ESP32 Anwendungen.

Schritt-für-Schritt: Vom Modell-Training Python zur ESP32 Inferenz

Hier ist der bewährte Workflow, um ein ML-Modell (am Beispiel einer Sinus-Wellen-Vorhersage) auf Ihre Hardware zu bringen. In diesem TinyML Tutorial Deutsch decken wir jeden Schritt ab.

Schritt 1: Modell-Training Python (Host-PC)

Zunächst beginnt jedes Projekt mit dem Modell-Training Python auf einem Desktop-PC oder Server. Wir nutzen dazu die High-Level API Keras, um die Basis für unser TensorFlow Lite ESP32 Projekt zu legen.

Voraussetzung: pip install tensorflow

import numpy as np

import tensorflow as tf

from tensorflow import keras

# 1. Datensatz generieren für Machine Learning auf Mikrocontrollern

angles = np.random.uniform(low=-np.pi, high=np.pi, size=(1000, 1))

sines = np.sin(angles)

# 2. Modell definieren

model = keras.Sequential([

keras.layers.Dense(1, input_shape=(1,))

])

# 3. Kompilieren und Trainieren

model.compile(optimizer='adam', loss='mean_squared_error')

# Start des Modell-Training Python Prozesses

model.fit(angles, sines, epochs=100, verbose=0)

# 4. Speichern

model.save('sine_model.h5')Schritt 2: Konvertierung für TensorFlow Lite ESP32

Der ESP32 kann keine Standard-Dateien verarbeiten. Für eine schnelle ESP32 Inferenz muss das Modell optimiert werden.

Befehl:

tflite_convert --keras_model_file sine_model.h5 --output_file sine_model.tfliteSchritt 3: Umwandlung in C-Byte-Array

Damit die ESP32 Inferenz ohne Dateisystem funktioniert, binden wir das Modell direkt in den Flash-Speicher ein.

xxd -i sine_model.tflite > sine_model.hSchritt 4: Setup und Code für ESP32 Inferenz

Nach dem Modell-Training Python und der Konvertierung folgt nun der C++ Teil auf dem Controller.

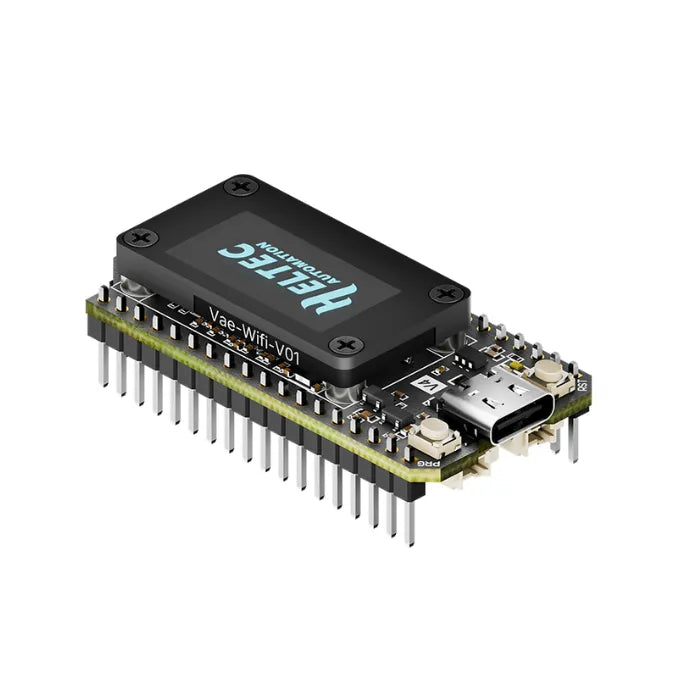

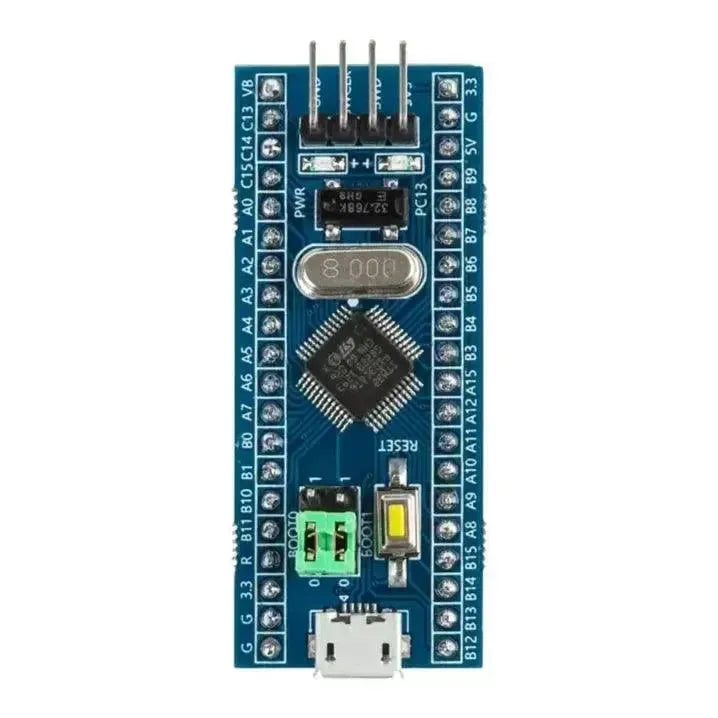

- Board Support: Installieren Sie die ESP32-Definitionen.

-

Bibliothek: Nutzen Sie die

TensorFlowLite_ESP32Lib für optimale Performance bei Machine Learning auf Mikrocontrollern.

Schritt 5: Der Inferenz-Code (C++)

Hier fügen wir alles zusammen. Der Code initialisiert den Interpreter für die TensorFlow Lite ESP32 Anwendung.

#include <TensorFlowLite_ESP32.h>

#include "sine_model.h"

// ... Includes für MicroInterpreter ...

constexpr int kTensorArenaSize = 2000;

uint8_t tensor_arena[kTensorArenaSize];

void setup() {

Serial.begin(115200);

// Modell laden für ESP32 Inferenz

model = tflite::GetModel(sine_model);

// Interpreter Setup für Machine Learning auf Mikrocontrollern

static tflite::MicroInterpreter static_interpreter(

model, resolver, tensor_arena, kTensorArenaSize, error_reporter);

interpreter = &static_interpreter;

interpreter->AllocateTensors();

}

void loop() {

// Inferenz ausführen

if (interpreter->Invoke() != kTfLiteOk) {

return; // Fehler bei der ESP32 Inferenz

}

// ... Output verarbeiten ...

}Technische Analyse & Hintergründe

Speicher-Management bei Machine Learning auf Mikrocontrollern

Ein kritischer Aspekt bei TensorFlow Lite ESP32 Projekten ist das RAM. Die Tensor Arena ist der Arbeitsbereich für die ESP32 Inferenz. Ist sie zu klein, schlägt das Modell fehl.

Zusammenfassung des Workflows

Dieses TinyML Tutorial Deutsch hat gezeigt, dass der Prozess logisch strukturiert ist:

| Schritt | Fokus | Tool |

|---|---|---|

| 1. Training | Modell-Training Python | Keras / TensorFlow |

| 2. Konvertierung | Optimierung für TensorFlow Lite ESP32 | tflite_convert |

| 3. Ausführung | Live ESP32 Inferenz | C++ Firmware |

Fazit

Die Implementierung von TensorFlow Lite ESP32 ist kein Hexenwerk mehr. Für Ingenieure, die Machine Learning auf Mikrocontrollern beherrschen, bietet dieser Stack eine mächtige Kombination. Wir hoffen, dieses TinyML Tutorial Deutsch hilft Ihnen beim Start Ihres nächsten Projekts.